スタジオ・マルチ収録作品におけるイマーシブ・オーディオの可能性【前編】

360 Reality AudioやDolby Atmos Musicが本格的にスタートし、多くのリスナーがイマーシブでのリスニング体験をスタートし始めている今、オーディオエンジニアにはどの様なスキルが求められているのでしょうか。

この記事には、前編と後編の二部構成にて、商業スタジオでのイマーシブ収録からミックスまでの制作過程が詳細な記録と共にドキュメントされています。

記事を寄稿いただいたのは、国内におけるイマーシブサラウンドの第一人者であり、自他共に認めるイマーシブ・オーディオ研究家である、入交英雄氏。

入交氏は、MBS毎日放送時代より様々なサラウンド収録やミックスの研究と放送に携わり、現在は株式会社WOWOWにて、その手腕を遺憾無く発揮し様々な業務に携わる、日本のイマーシブサラウンドシーンを牽引するエンジニアです。

「3Dオーディオ収録が計画されたという点において、今回の3Dオーディオ制作は、スタジオ・マルチ収録ベースの音楽作品ではおそらく日本初の試みだったのではないかと思う」と氏が語る、実際の商業作品の制作を通じて得られた「生きた」インフォメーションをお届けいたします。

筆者

入交英雄氏|Hideo Irimajiri

株式会社WOWOW

1956年生まれ。1979年九州芸術工科大学音響設計学、1981年同大学院卒。2013年残響の研究で博士(芸術工学)を取得。1981年(株)毎日放送入社。映像技術部門、音声技術部門、ホール技術部門、ポスプロ部門、マスター部門を歴任した後、2017年より(株)WOWOWへ出向。2020年よりWOWOWエグゼクティブ・クリエイターに就任。1987年、放送業界初となる高校野球サラウンド放送のプロジェクトに関わる。2005年より放送のラウドネス問題研究とARIB委員、民放連委員を通じて規格化に尽力した。学生時代より録音活動を行い、特に4ch録音や空間音響について探求を重ね、現在では3Dオーディオ録音の技術開発と共に、精力的な制作や普及活動を行っている。また、個人的にも入間次朗の名前で音楽制作活動を行っており、花園高校ラグビーのオープニングテーマやPCゲームのロードス島戦記などを担当した。

初めに

2017年の秋も深まった頃、関西大学の三浦文夫先生より相談があった。

「南佳孝氏のニューアルバムをプロデュースすることになったのだが、CD以外にも何か仕掛けが欲しい。スタジオ録音だけどイマーシブ・オーディオで仕上げることは出来ないだろうか?」

その頃、私は3Dイマーシブ録音の収録法の開発に余念が無く、三浦先生も私の収録したイマージブ録音作品を試聴され、ご興味をお持ちになっていた。実はイマーシブ録音に取り組みはじめて対象はライブばかりだった。CDプロダクションと同時進行する3Dオーディオ録音は果たして効果的なのか?いずれにしても革新的な取り組みになると直感した。

CD録音と言えばマルチマイク収録。ミュージシャンが入れ替わり立ち替わりスタジオを訪れては譜面を埋めていく。3Dオーディオの重要なコンセプトである「現場を切り取って再生空間へ表現」という部分において、その「現場」が無いのである。つまり元々ないものを創り出す必要がある。

もちろん音が動き回って、びっくりさせて、というアプローチは映画でもやっていることだし、演出さえしっかりすれば面白い作品が出来るだろう。しかし、音楽の本質を伝えるためには小細工は却って邪魔になる。ワンポイント・エフェクトは有ったとしても、3Dイマーシブ録音においては音楽に没入できると言うことが最重要である。

このようにしてよりスタジオ・マルチ収録作品において、音楽の感動を聴衆に伝える手段として3Dオーディオがどの程度有効か検証する実験はスタートした。

理論編

1) 没入の要素

まず「没入」の意味を考えたい。

この状態は紛れもなく、他の色々な刺激が気にならなくなり、音楽そのもの、音そのものだけ聴き入っている状態で、言ってみれば極限の集中状態である。

ホールで音楽を聴くとき、ホールの響きに包み込まれるわけだが、近くの人が咳払いをすると、はっと我に返ったという経験はあるだろうか?3Dオーディオ試聴会でも同様に近くの人が咳をすると我に返るのだが、不思議なことにスピーカより外側の人のことは気にならない。360°取り囲んだスピーカから放射される音のカーテンのせいだろうか?

さて、人の聴覚にはマスキングという現象が有る。マスキングには 「同時マスキング」、「経時マスキング」、「方向性マスキング」という3つの種類がある。その中で「方向性マスキング」というのは、2種類の音源があるとき、それらの音源方向が自分から見て大きく離れていると両者を同時に知覚できるが、音源方向を近づけると一つの音にもう一つの音がかき消されるという現象である。

すなわち、ステレオで聴いていると気になる部屋の雑音が、複数のスピーカで聴取者を取り囲む3Dオーディオ再生では、方向性マスキング効果によりスピーカから再生される音だけが聴こえるようになるのではないかと考えた。

実際、国際放送機器展などで3Dオーディオのデモンストレーションを行うと、周りの騒々しい音が気にならなくなる。すなわち3Dオーディオによって音に包みこまれるとき、音響心理的には「包み込まれ感」が大きい状態と考えられる。誤解を恐れずに言うならば、包み込まれ感の大きい作品はより没入感を生みやすいのではないだろうか。もちろん逆は真ならず、と言うこともあるわけだが、包み込まれ感というキーワードが重要で有ることは間違いない。

2) オブジェクト臨場感とフィールド臨場感

富山大学の安藤教授が提唱した言葉に「オブジェクト臨場感」と「フィールド臨場感」というものがある。

臨場感とは 「まさにその場に居合わせたかの様に感じる様」 を表しているのでオブジェクト臨場感についてピンとこない人もいるだろう。これは大雑把に言えば、楽器の音が生々しく楽器の音に聞こえる感覚、と考えれば良い。それに対しフィールド臨場感はホールや教会など、まさにそこの空気感と言っても良い。

ここで、音声エンジニアなら誰でも自然とやっている行為、つまりオフマイクにオン・マイクを混ぜるという方法は、オブジェクト臨場感とフィールド臨場感を組み合わせて丁度良い状態を合成していることに他ならないのである。

このように音の要素をオブジェクトとフィールドに分けて考えると、作品制作が理解しやすくなる。そして広がり感はオブジェクト臨場感に依存が強く、包み込まれ感はフィールド臨場感に依存が強いと考えると腑に落ちるのである。

3) 「広がり感」と「包み込まれ感」

3Dイマーシブ・オーディオにとって重要な要素は「包み込まれ感」と言うことを説明したが、もう一つ再生音響にとって重要な要素に「広がり感」がある。前項にも述べたが、「広がり感」は前後左右および上下に音源が広がって、或いは色々な場所に散らばって聴こえるような感覚であるのに対し、「包み込まれ感」は前後左右上下に音源が存在するのではなく、音像が充満して包み込まれる様な感覚を指している。広がり感と包み込まれ感を理解すると、3Dオーディオを判りにくくしている概念である「オブジェクトベース」と「チャンネルベース」についても判ってくる。

4) オブジェクトベースとチャンネルベース

オブジェクトベース

オブジェクトとは音源のことを指し、オーケストラでいえば各楽器と捉えても良いだろう。多くの音響作品は複数のオブジェクトによって構成されているが、それらオブジェクト毎に信号データを割り当て、記録伝送し再生システム上で合成するのがオブジェクトベースの考え方となる。

ざっくりと説明すると、マルチチャンネル制作では、一つの作品を制作するのに各要素をマルチチャンネルレコーダーに記録してミックスダウンするという基本の流れはチャンネルベースもオブジェクトベースも同じである。

チャンネルベースでは2chステレオなど音声モードに応じてミックスダウンされたマスターファイルを納品するわけだが、オブジェクトベースでは各オブジェクトの音声信号を、それぞれ時間と共に変化する、音量、音源位置情報、EQなどのパラメータをメタデータと一緒に記録し、再生側で音声モードに応じてミックスすることにより実現する。Pro Toolsのセッションデータごと再生環境に送りつけてオートメーション再生する、というイメージだ。

オブジェクトベースの最大の利点は、制作環境と再生環境のスピーカ配置などの音響パラメータを測定しておけば、それら差分に基づいてメタデータを変換することにより、再生環境においてスピーカ数やスピーカ配置が制作ミックスダウンスタジオと異なっていても、ミックスダウンした意図通りに再構成して再生できるという特徴を持っている。

チャンネルベース

一方チャンネルベースは乱暴に言えば通常の制作スタイルのことで、音量、音源位置情報、EQなどのパラメータは音声モードに応じたマスターファイルの中で各チャンネルの音量差、位相差、音色変化と言う形で固定されてしまう。

従って、チャンネルベースでは、制作環境と再生環境が一致することが前提となる。すなわち再生側で音声モードに応じた標準スピーカ配置が成されていないと、制作時の意図とは異なった状態で再生される。

例えば自分を中心とする円周上に音源を等速度で回転させるミックスを作った場合、スピーカ配置の異なる再生空間では、スピーカ間の距離が制作時より短くなったところでは遅く、逆にスピーカ間の距離が離れたところでは早く回転し、等速度で回転しているようには聴こえなくなる。

オブジェクトベースとチャンネルベース

このように、単一音源で考えるとオブジェクトベースの性能が上回っているように思えるかも知れないが、ペアマイクを考えた場合はどうだろうか?

ステレオペアマイクは、2つのマイク間に存在する音源を、それらがマイクに到達した時のレベル差と位相差によって、ステレオ再生スピーカの間にファントム音像として表現される。すなわちステレオペアはペア間に無限のファントムオブジェクトを持っていることに等しい。

このステレオペアを2つのオブジェクトと考えると、再生空間の任意の位置に2つのバーチャル・スピーカとして貼り付けることは可能である。しかし、もともとステレオペアに含まれていた無限のファントムオブジェクトは2つのリアル・スピーカ間に表現されたファンタム音像よりもぼけがちである。むしろバーチャル・スピーカ位置に近い2つのリアル・スピーカに張り付けた方が、ピントの合った音となって再生される。これはファンタム定位が2つのスピーカによる合成定位なのか3つ以上のスピーカによる合成定位なのかによって印象が異ることを意味している。数学的には同じ結果になるかもしれないが、実際は人間の両耳間に距離があり、しかも絶えず頭は動いているものなのでそうは問屋が卸さない。オブジェクトベースは万能ではないことを押さえておく必要がある。

Dolby Atmos® はオブジェクトベースの代表格と思っている人も多いが、最初からベッズと呼ばれるチャンネルベースを併せ持っている。システムを構築した人はこの辺りを心得ている訳で、巷ではオブジェクトベースが良いとかチャンネルベースが良いと議論されているが、どちらも重要かつ状況に応じて使い分けることが肝要と思う。

5) オブジェクトベースと臨場感

先ほどオブジェクト臨場感について述べたが、オブジェクト臨場感とオブジェクトベースは別物である。

オブジェクト臨場感を構成する要素は、例えば楽器そのものの音であったりする。しかし楽器は点ではなくある程度の広がりや大きさを持っている。そして楽器の様々ところが共鳴して楽器らしさを創っている。すなわち楽器はオブジェクト一つで表現できるとは限らない。

さらに例えばバイオリンを無響室で聴くと何とも味気なく、まるで発信器のように聴こえ、もはやそこに臨場感ない。すなわち、初期反射音もオブジェクト臨場感の重要な構成要素になっていると考えられる。初期反射音は、そこがどのような部屋なのかを感じる重要な要素であり、反射音のレベル、方向、周波数特性などのパラメータから成る。つまり反射音一つ一つがオブジェクトというわけである。

もし、オブジェクトオーディオだけでオブジェクト臨場感を表現するとすれば、楽器と(一つのオブジェクトに省略できることもあれば複数のオブジェクトが必要なときもある)2次反射音くらいまでの反射音をオブジェクト化すれば良いと考えられる。

しかしながらこのようなオブジェクト化は音合成ではあり得てもライブ収録で実現することは困難である。ライブ収録では通常スポットマイクとオフマイク(ペアマイク)に切り分けて集音し、ファントム音像の中にそれら要素を表現することになる。

そこでメインマイクを上下2層に分け、すなわち私がよく使うデッカツリーを2段重ね(ダブルデッカ)とすることによりオブジェクト臨場感が向上することを発見した。ステレオでは左右の線状にしかファントム音像が並ばないが、ダブルデッカにすることにより上下左右の面状にファントム音像が並ぶためと考えられる。

こう考えるとオブジェクトオーディオだけでオブジェクト臨場感を表現するには莫大なオブジェクトが必要であり、現実的ではないと思うのである。

6) 3Dオーディオ 制作の留意点

「広がり感」は定位などの表現に優れるオブジェクトベースの方が制御しやすく、「包み込まれ感」は本質的にファントム音像を用いるチャンネルベースの方が制御しやすいと考えられる。

従ってオブジェクトベースとチャンネルベースという考え方は両方必要でDolby Atmos® にしてもAuroMax® にしても両方の技術を併せ持っている。広がり感の向上のためにはオブジェクトベースに着目し、包み込まれ感の向上のためにはチャンネルベースに工夫を凝らして制作することが肝要だと考えている。

しかし、ここにもう一つ重要なことがある。

今まで述べた議論はシアターサイズのシステムであり、Dolby Atmos Home、Auro-3D® では注意することがいくつかある。すなわちAtmosでは伝送路の容量の問題で本来112個記録できるオブジェクトはスペーシャルコーディングという技術によりデフォルトで12個にグルーピングされること、再生スピーカ位置は代表的な位置として決められており、再生環境のパラメータとして反映できないこと、Auro-3D®はそもそもオブジェクトを持っていないことに気をつける必要がある。

すなわち、オブジェクトベースの再生場所を選ばず定位の一貫性が保たれるという最大特徴は担保されず、スタジオで制作した演出が家庭でもそのまま再現されるという考えは間違いである。しかし、家庭は映画館のような広い部屋ではなく、劇場よりも遙かにダウンサイジングした再生システムを用いるが、3Dオーディオのすばらしい表現能力が毀損されることはない。

そのためには、3Dオーディオ制作者に課せられた使命として、今までスタジオミックスした楽曲を、ラジカセで、カーオーディオで確認したように、3Dミックスした作品も家庭で、今後普及するとみられるカーオーディオで確認し、それぞれで許容できる誤差を意識してミックスすることが必要となる。

実践編

1) 南佳孝氏の「Dear My Generation」プロジェクト設計

最初から3Dオーディオ収録が計画されたという点において、今回の3Dオーディオ制作は、スタジオ・マルチ収録ベースの音楽作品ではおそらく日本初の試みだったのではないかと思う。

既に述べたように、3Dオーディオを制作する上で、「コンセプト」をはっきりさせておくことが重要である。この作品では、南さんのバンドが集うスタジオに遊びに行って、その真ん中でセッションを聴くという贅沢な設定をコンセプトとした。

3Dオーディオを聴いたときに満足感を得るのに重要なファクターは包み込まれ感であり、今回のプロジェクトでも包み込まれ感を表現できるマイクアレンジを工夫し、没入感に富む作品とすることを最大の目的とした。

実験制作を行った曲は全部で3曲であったが、小誌ではその中でも代表作となる「ニュアンス」の制作過程を紹介する。

2) 3Dオーディオ ・フォーマットとミキシングの注意点

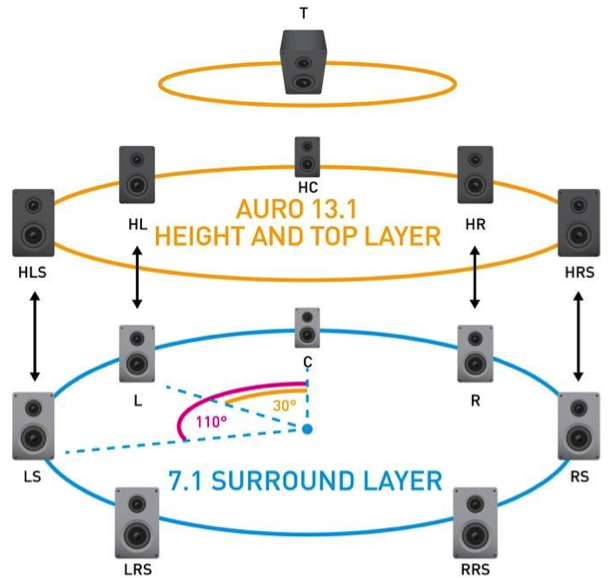

再生システムは、現状考えられる最大のシステムとしてAuro13.1に対応できる様にスピーカ配置をし、14chのマルチチャンネル作品としてマスターを制作することにした。

ここでチャンネルネームを確認しよう。各方式で名前が違っており混乱の元であるが、今回はAuroの表示名称を踏襲し、ミッドレイヤ:L, C, R, LS, RS, LRS, RRS、ハイレイヤ:HL, HC, HR, HLS, HRS トップレイヤ:T(VOG)とする。

Atmosとの関係はLS=Lss, RS=Rss, LRS=Lsr, RRS=Rsrとなる。非常にややこしく、私も各方式の名称を混在してしまうことがある。

次に再生する部屋の大きさは12~20畳くらいのちょっと大きめのリビングを想定した。

3Dオーディオのミキシング設備はまだまだ少ないが、自宅ホームスタジオにAuro13.1の推奨配置(Fig 1)でスピーカを配置しミックスを行った。

ミッドレイヤのスピーカ半径は2.2m確保することが出来た。ハイレイヤのスピーカはミッドレイヤのスピーカのほぼ真上にあり仰角は約30度である。VOGはミキサ席の真上に吊したが天井高が2.6mしかなく、耳とスピーカの距離は他のスピーカに比べ半分以下となっているため、このチャンネルのみに5msのディレイを挿入した。

各スピーカは-23dBFSrmsのピンクノイズを再生したとき聴取位置で79dB(SPL)となるように調整した。なお各スピーカのアライメントは非常に重要である。ピンクノイズによる音圧レベル校正だけは確実に行うようにしよう。

3Dオーディオは再生環境によって聴こえ方がかなり変わる。業務スタジオでさえスタジオによって印象が変わり、何を信じてミックスすれば良いのか判らなくなることさえ有る。

ということは家庭に普及した場合、各家庭によって全く異なった音で聴いている可能性が高いので、再生環境が変わっても出来るだけ制作時の印象を保てるミックス方法の確立が必要である。理想的なスタジオでしか成立しないようなミックスではとても家庭への普及にはおぼつかない。5.1サラウンドの轍を再び踏んではならないことを肝に銘じよう。

幸い、同じミックスを色々なスタジオや仮設環境で再生した経験を通じ判ったことであるが、理論編でも述べたようにペアマイクなどそれ自身にファントム定位を持っているチャンネルはパンポットやダイバージェンスを用いたバーチャル・スピーカとして表現してはいけない。特に仮設環境では全てのスピーカが同一モデルで有ることの方が珍しく、例えスピーカアライメントを調整しても、複数のスピーカから合成され右バーチャル・スピーカは音色が変わり音楽バランスそのものまで影響することが多い。

定位の異なりは許容できたとしても、音楽のバランス変化は許容できないので、ここが3Dオーディオミックスにおける肝である。まだ普遍的なミキシング法を見つけるに至っていないが、まず「ペアマイクにはパンポットとダイバージェンスを用いない」というノウハウを得ることが出来た。

3) 収録方針

マルチマイク収録の場合、どこに何を定位させるなど立体空間の創造は全くイメージの産物である。ライブで演奏会場を切り取って表現するという3Dイマーシブ・オーディオのコンセプトにどのようにマッチするのか、これが今回の課題であった。すなわち、収録中のスタジオにお邪魔しその真ん中で聴くという設定としたが、我々制作サイドでは日常茶飯事の経験も通常のステレオ聴取ではあり得ない表現が聴取者にどのように受け入れられるのだろうか?という問題である。

さて、実際にリハーサルをスタジオ内で聴いて見ると、結構な反響が有ることに気が付く。CDでは後の加工を考えドライな音で収録することが多いが、この反響が重要な要素になるはずだ。次に自分を取り囲むように押し寄せてくるサウンドを確認する。実際に自分の周りにミュージシャンがいるから当然なのだが、それが見えない家庭で聞くとどうなるのか?そもそも音楽そのものに没頭させることは出来るのか?

そういったことを想像しつつ、

- スタジオ空間のアンビエンスはアコースティック楽器について収録すること。

- スタジオ空間には初期反射音はあってもリバーブが不足するので、スタジオアンビエンスとリバーブプラグインでバーチャル空間を作っていくこと。

- 大胆な楽器配置は行うが、楽器を移動するなどの演出はしないこと。

- 具体的な配置はミックスダウン時に検討すること。

という方針で収録に臨んだ。

4) マイクアレンジ

滑らかな包み込まれ感(空間のつながりが感じられる)を得るには、経験的に4本の無指向性マイクを正方形に配置した一組のマイクアレイを用いると良い事が判っている。この配置を「オムニクロス」と呼んでいるが、今回の録音では1辺1.5mのオムニクロスをハイトマイクとして用いた。以後ハイトアレイと呼ぶことにしよう。

収録を行ったHeartBeat – RECORDING STUDIOは天井が高く(約5m)、3Dオーディオ収録に向く空間である。ドラム、ピアノ、ストリングス、ブラスの各アコースティック楽器の収録時(合計4セッション)に3D用のマイクアレンジを加えることにした。

このときハイトアレイ以外にもスタジオの端にアンビエンスマイクを置くなど合計6本のマイクを3Dオーディオ用に収録した。従って、4セッションの収録でプロツールスの24ch分を消費する。

また、ボーカルダビングの時、狭いブースでの収録となるが、オブジェクト臨場感の向上に上方からの音(反射音)が寄与するので、トップフロントセンター用として1本のアンビエンスマイクを使用した。

なお、HeartBeatスタジオのメイン卓はNeveのVR-72(アナログ卓)で、まさにレコーディングの王道を垣間見た。

ヴィンテージマイクも揃っており、レコード産業が華やかかりし頃のレコーディングスタイルで進行していった。

これを操るのはレコーディングエンジニアの片倉麻美子女史。私から見れば2周りほど若い世代なのに、ビンテージ機器の使いどころは壺を得ていた。

その王道に合わせた3Dオーディオ用のマイクロホンは、一転、最新テクノロジーのデジタルマイクロホン(Neumann KM D 133)だ。アンビエンスマイク(空間音収録)はオーディエンスマイク(観客アプローズ収録)として軽視されることが多いが、3Dオーディオ録音において実はアンビエンスマイクこそ気遣わなければいけない。そして、オーディエンスマイクとアンビエンスマイクでは明らかに役割が異なることを肝に銘じなければならない。

よく、アンビエンスマイクに無指向性マイクを使ってPAの被りは大丈夫なんですか?という質問を受ける。私も若い頃は単一指向性マイクを何本も並べて歓声を録ろうとしたものだった。しかし、クラシックだろうがガンガンのロックだろうが、気配を収録するには無指向性マイクが一番である。実は私もそのことに気がついたのは3Dオーディオ録音を始めてからで、もっと早く気づけばもう少しましな5.1サラウンド作品を制作できたに違いないと後悔している。

アンビエンスマイクはハイレゾで収録するためにも一番効果的かつ重要なマイクとなる。テレビ収録などではポップス系のPAもらいをするときMADIを使用することが多くなったが、PAはまだまだ48kサンプリングを使用していることが多い。例えばPAが使用しないアンビエンスマイク系をネイティブ192kで収録しPA業者もらいの信号は48kであったとしてもアナログで受け渡しして192kで収録し仕上げると、最初から48kだったときに比べると明らかに音質が進化していることに気付く。アンビエンスマイクさえハイレゾであれば、作品全体も充分にハイレゾを名乗れる。

3Dオーディオ用に別立てしたKM D 133とKM D 143はRMEのデジタルマイクプリのDMC-842に接続しMADIとして出力する。MADI信号はスタジオからマシンルームへ敷設されたビデオトランク線(BNC)を介してマシンルームに持ち込んだADI-642でAESに変換しスタジオのPro Toolsシステムへ入力した。

この方法が現状では最も高S/Nが期待できる。

なお、今回のプロジェクトは全体のパフォーマスを考慮して96kHz/32bitのプロジェクトとして行われた。

それでは、以下、具体的なマイクアレンジについて見ていこう。