Apple Music 空間オーディオ作品の音質を向上させる方法

「Dolby Atmosミックスした作品をApple Musicで空間オーディオとしてヘッドフォンで聴いたら制作時と異なる音になる」

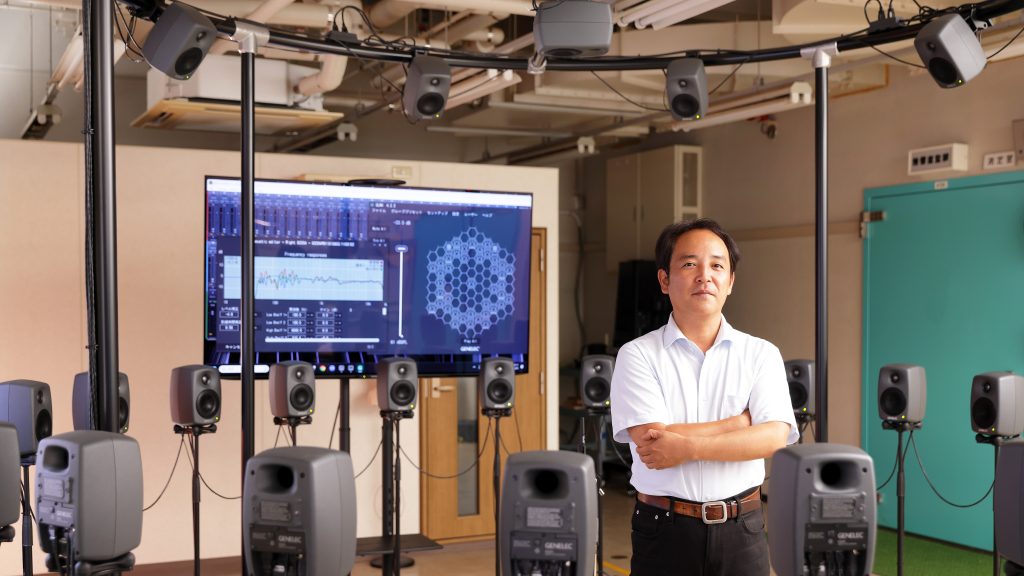

Dolby Atmos対応コンテンツを制作する現場からの複数の訴えを耳にしたことがきっかけでこの記事は生まれた。イマーシブオーディオの第一人者として知られるWOWOWの入交英雄氏もこの課題に直面していると聞き状況を打開するヒントを探るためにインタビューをお願いした。

なぜ、Apple Musicで空間オーディオで聴くと音が異なってしまうのか、解決策はあるのか、そして、Appleの真意はどこにあるのか。数々の疑問の真相に迫ると同時に、Dolby Atmosの配信コンテンツの音質劣化を最小限にとどめる、入交氏、一流の手法についても併せて語ってもらった。

文・取材◎山崎潤一郎

13.1チャンネルの中間ミックスを作る理由

Apple Musicにおけるバイノーラル問題の本質に迫る前に、入交氏がエンジニアリングを担当し、21年5月にRME Premium Recordingsから発売された『冨田勲・源氏物語幻想交響絵巻』(ステレオ&イマーシブ・オーディオ・フォーマットBlu-Rayディスク& CD、以下『源氏物語』)を題材に、複数の再生フォーマットに対応するためのミキシング工程について触れておく。入交氏が導入した音質と効率化を追求した手法は、Dolby Atmosの配信音源制作時における音質劣化対策とも関係しているからだ。

大阪のいずみホールで演奏された『源氏物語』の収録は、デッカツリーを中心に演奏そのものを狙うマイク群と、会場のホールトーンを収録するためのアンビエンスマイク群という2区分のマイク群(合計36本)を使い収録した。実際のトラック数は、これにエフェクトトラックなどが加わり約50にも及ぶ。

Apple MusicでDolby Atomosを聴く場合は、携帯などのアプリを使ってヘッドフォンでお楽しみいただけます。また、対応AppleTVとAVアンプを使えばスピーカーでもお楽しみいただけます。

Amazon Music UnlimitedでDolby Atomosを聴く場合は、携帯アプリからヘッドフォンにてお楽しみいただけます。

発売済みのBlu-RayディスクとCDは、Dolby Atmos、Auro 3D、5.1ch サラウンド、ステレオ、HPL (Head Phone Listening)といった複数の再生フォーマットに対応している。だが、これらすべてのフォーマットについて個別にミックス作業を実施していたのでは、時間がいくらあっても足りない。今回、入交氏が執った手法は、中間ミックスを作成するというものだ。

「まず、約50チャンネルのフルトラックから13.1チャンネルの中間ミックスを作成します。この13.1チャンネルから各イマーシブフォーマットを作成します。各イマーシブフォーマットへの変換は、特定のチャンネルをルールに則ってダウンミックスするなど、ほぼ決まった手順で効率的に行えます。なお、2チャンネルステレオは中間ミックスから再ミックスします」(入交氏)

規模の大きなマルチトラック録音であっても、13.1チャンネルの中間ミックスを満足のいくものに仕上げておけば、その後の行程を省力化できるというわけだ。また、ステレオミックスについても、フルトラックから直接2チャンネルにトラックダウンしたものと比較したそうだが、「中間ミックスからステレオ音源を作成する場合、2回の工程を経るので、理屈の上では音質が劣化することになります。ただ、比較して差異を感じる人は、まずいないと思います」(入交氏)と自信を見せる。

チャンネルベースを使った納品方法

前述の13.1チャンネル中間ミックスを作成するのは、家庭用3Dオーディオの事実上の最大フォーマットであるAURO13.1を意識してのものであるが、下位の3Dオーディオフォーマットに比較的簡単にダウンミックスできるから、という理由でもある。

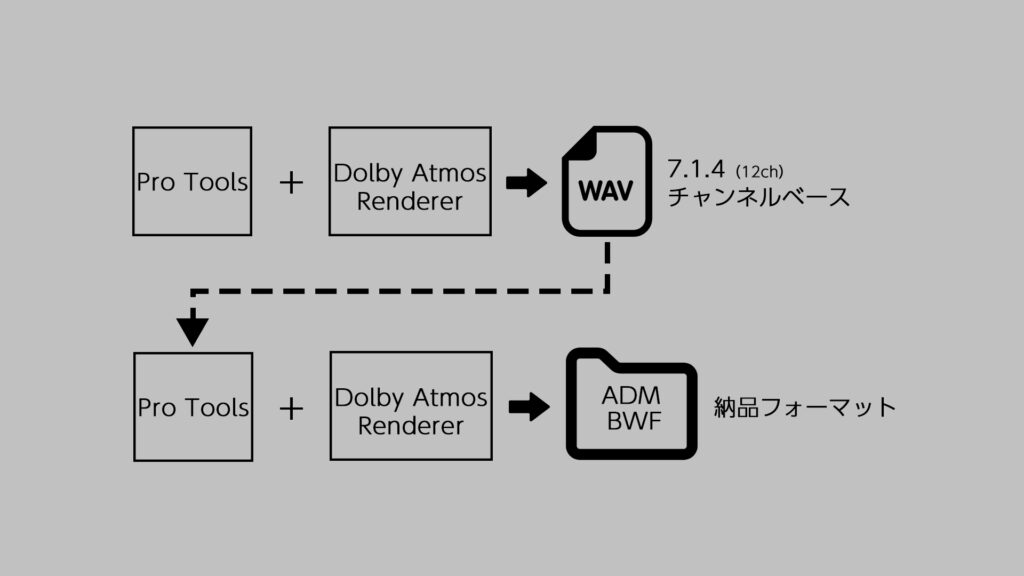

入交氏の手法は「最終形はチャンネルベースで仕上げる」という考え方にある。Dolby Atmosの納品用完パケ音源を作成する際には、チャンネルベースだけで構成されたミックスを作り、Pro ToolsからADM BWFの書き出しを行うというのだ。

Dolby Atmosミックスの醍醐味は、3D空間の任意のポイントにオブジェクト音源を配置したり移動させたりすることにある。チャンネルベースだけで構成されミックスから書き出しを行ったのでは、Dolby Atmosの醍醐味や魅力が失われてしまうのではないのだろうか。

「Pro Toolsのフルトラックで構成されたソースセッションからの13.1中間ミックス作成は、チャンネルベースで行います。メインマイク、アンビエンスマイク、スポットマイクなどいくつかのステムに分けますが、それぞれミッドレイヤの7.1ch、ハイトレイヤの5.1chのバスを使用します」(入交氏)

「ハイトレイヤのLFEチャンネルをVOG(頭上のスピーカ:Atmosには存在しない)として用います。ミックスが完成したら、7.1ch+5.1chとしてバウンスし13.1chミックスファイルができあがります。このファイルから新たなDolby Atmosセッションを作成します。もちろん7.1ch+5.1chをAUXバスに替えて直接Dolby Atmosセッションにすることもできます」(入交氏)

「ミッドレイヤの7.1chはベッズとして、ハイトレイヤの5.1chは、4chバスにダウンミックスして4chのオブジェクトとして用います。なお、ハイトレイヤは通常は動かさないので固定オブジェクトとなります。この段階が、いわゆる一般的なDolby Atmosのミックスを構成することになり、接続されたDolby Atmos Rendererの出力フォーマットを7.1.4とすることにより、目的のレンダリング処理を行ってADMBWFを作成します。しかし、最新のPro Toolsは、バウンスセクションで納品用のADM BWFを直接書き出すことができます」(入交氏)

文章だと手順が複雑に感じるが、Dolby Atmosのミックス作業から納品用のADM BWFの書き出しまでは、以下の工程を踏むことになる。

(1)フルトラックのPro Toolsセッションでチャンネルベースの13.1chミックスを行なう。

(2)そのミックスからDolby Atmos 用のルーティング(7.1.4)を用い、Renderer出力でモニタリングする。

(3)諸々OKであれば、Pro Toolsのバウンス機能を用いて納品フォーマットに合わせたADM BWFとして書き出す。

この納品用のファイルの12チャンネル(7.1.4)のトラック構成は、7.1のベッズと4チャンネルの固定オブジェクト(ハイト・スピーカー用の固定オブジェクト)で成り立っている。

音質面と3Dの表現力でバランスの取れた手法

ここで疑問に思う向きもあるだろう。チャンネルベースにすることでオブジェクトトラック音源のメタデータの情報が欠落し、3D空間の表現力が低下するのではないのか、という心配だ。

「チャンネルベースなので、パンポット調整によるサラウンドスピーカーの音量差で3D空間を再現する形になりますが、表現力は変わりません。オブジェクトベースの本来的意義は、各映画館においてスピーカー配置に差異があった場合、再生のレンダリング処理でメタデータをベースに定位や移動情報を補正してくれる点です」(入交氏)

「しかし、家庭向けの7.1.4システムではスピーカの配置が固定されているので補正機能がありません。このときレンダラーは複合的なパンニングシステムと捉えることが出来ますが、制作時にパンニングしてしまうか、パンニング情報で再生時にパンニング処理するかという違いがありますが、結果的にどちらでも同じ結果となります。つまり家庭用のAtmosではオブジェクトの利点を活かすことが出来ないのです」(入交氏)

また、チャンネルベースで一旦レンダリングする手法は音質面でも大きな効果を発揮する。

「音質を追求しつつDolby Atmosの3D空間を表現するためにもこの手法は活きてきます。もし、ソースのフルトラックを個別にオブジェクトとしてミックスした場合、書き出した納品用のADM BWFファイルには、ベッズに加え、たくさんオブジェクトトラックが含まれることになります」(入交氏)

「たとえば、Blu-rayディスクの音声コーデックであるDolby TrueHDだと帯域幅が決まっているので、トラック数で帯域をシェアすることになり、1トラックあたりのビットレートが小さくなり、音質の劣化を招きます。12チャンネルにダウンミックスした状態であれば、ロスレス並の帯域幅を確保できます。この考え方は、配信時に使用するフォーマットであるDolby Digital Plusも同じです」(入交氏)

配信においても一定の音質を確保するために前述の手法が有効だ。たとえば、Dolby Digital PlusでストリーミングされているApple Musicの帯域幅は、768Kbpsと言われている。仮に、Dolby Digital Plusの上限である15.1チャンネルで作成されたコンテンツを配信すると、1チャンネルあたりの帯域幅は、768÷16=48Kbpsに制限される。

その一方で、前述の12チャンネルのミックスであれば、1チャンネルあたりの帯域幅は64Kbpsとなり「音質面と3D空間の表現力の双方でバランスの取れた配信が可能です」(入交氏)と説明する。

メタバースへの布石か?

Dolby Atmosのミックス手法についての知見が得られたので、いよいよ本稿のメインテーマであるApple Music問題に話を移したい。

この問題は、Dolby Atmos Rendererで納品用ADM BWFの書き出しを行った音が、実際にApple Musicで配信される音と異なる、というものである。Dolby Atmos Rendererのバイノーラル設定でモニタリングした際の音像や定位が、Apple Musicで実際に配信されると異なっているというものだ。

「実際、私がミックスを担当した『ボブ・ジェイムス/Fell Like Making LIVE!』のDolby Atmos配信を聴いてみると、楽器の定位やバランスが異なりました」(入交氏)と驚きを隠せない。では、なぜこのような現象が起きるのだろうか。

「Apple MusicをAppleのデバイスとAirPodsシリーズのヘッドフォン・イヤフォンで再生する際は、Apple独自のバイノーラルレンダリング処理が施されているからです。実際、バイノーラル処理はデバイス側の独自のレンダラーで行っているようです」(入交氏)

Apple Musicは、拡張AC-3(Dolby Digital Plus、Joint Object Coding / DD + JOC)と呼ばれるフォーマットで配信されている。拡張AC-3では、Dolby Atmos用のファイルも扱えるフォーマットだが、Appleはこの再生に独自のバイノーラルレンダリング処理を付加しているというのだ。

では、Appleはなぜこのような独自の処理を行なっているのだろうか。その理由を入交氏は次の様に予想する。「AirPodsシリーズをApple端末で利用するとヘッドトラッキングが利用できます。Appleは、このヘッドトラッキング処理に何らかのこだわりを持っているのではないでしょうか」(入交氏)

では、そのこだわりとは何か。「近いうちに登場する予定のAppleのVRメガネにおいて独自のイマーシブオーディオ体験を提供するための布石だと予想しています」(入交氏)という。

近年、「メタバース」がバズっているが、3Dの仮想空間において、没入感を演出する場合、視覚情報に加えて、音が聞こえてくる方向も重要な要素となる。VRメガネを装着したユーザーが特定の方向に頭を向けると映像にリンクして音像も移動しなければ没入感が半減する。没入感を得るにはヘッドトラッキングが鍵を握るわけだ。

2021年に登場したiOS 15では、ビデオ通話アプリのFaceTimeが「空間オーディオ」(Appleはイマーシブオーディオをこう表現する)に対応した。複数の相手とビデオチャットができるこの機能のフューチャリングポイントは、会話をする相手の方向から、声が聞こえてくるというもの。仮にVRメガネを使いメタバースでFaceTime通話を行なう場合、ヘッドトラッキング機能の重要度が増す。

「Appleとしては、ヘッドトラッキングを含むバイノーラル処理をすべて自分達のコントロール下に置いておいた方が、Appleが求めるUX(ユーザー体験)を維持する上で得策と判断したのではないでしょうか」(入交氏)

Logic Pro 10.7.3でモニタリング

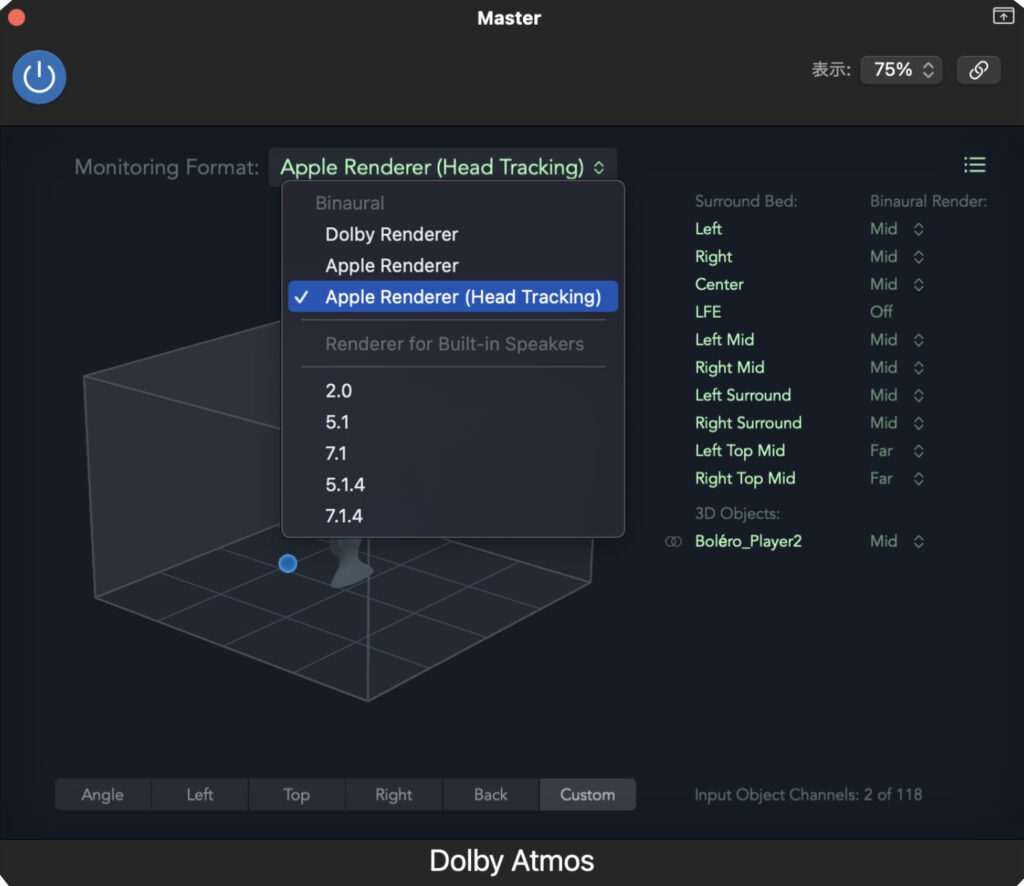

問題の原因やAppleの思惑が理解できても、エンジニアとしてはこの喫緊の課題に何らかの方法で対処しなければならない。1つ可能性があるのは、macOS 12.3の公開と同時に10.7.3にアップデートしたLogic Proを導入するという方法だ。

Logic Pro 10.7.3のバイノーラルモニタリング設定に「Apple Renderer」「Apple Renderer(Head Tracking)」という項目が追加されたからだ。この方法でモニタリングを実施することで、Apple MusicをApple端末とAirPodsの組み合わせで聴いたときのイメージに近い音でモニタリングできる可能性がある。

ただし、入交氏は「Logic Pro 10.7.3でモニタリングしてみましたが、実際にApple Musicで配信された音とは異なっていました」と顔を曇らせる。Logic Pro 10.7.3でモニタリングしても音が異なるというのでは、ほぼお手上げに近い状態と言えまいか。

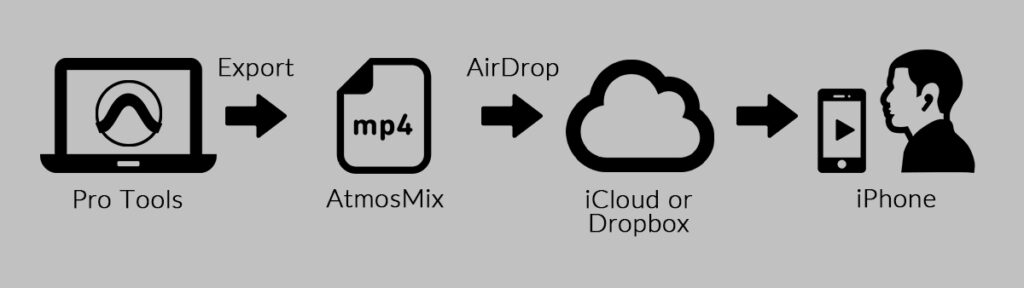

もう1つの方法として、iPhoneとiCloudの組み合わせで確認する方法もある。Dolby Atmos Rendererから音楽用MP4を書き出しiCloudにアップロードする。同じApple IDに紐付いたiPhoneであれば、端末内の「ファイル」AppでそのMP4を開くことができるので、AirPodsで試聴するという方法だ。iCloudばかりでなく、Drop Boxでも可能だという。

「しかし、もう一つ問題があります。この方法でAirPodsでどう聴こえるかは確認できるのですが、Apple Musicは、Apple TV経由でAVシステムに接続できます。このときには通常のDolby Atmos 7.1.4として再生できるのです。AirPodsの音質向上のために事前処理を行うと、AVアンプで聴いている人は逆に音が悪くなる可能性が高いのです。我々は両方聴いて妥協点を探るしかないようです」(入交氏)

音楽制作者の心情としては、エンドユーザーと同等の環境でモニタリングした上で、完パケのファイルを納品したいという想いがあるはずだ。Appleが今後どのような方向に進むのかは未知数なだけに、前述の方法などを駆使することで、制作者側で知見を蓄積していくことが、現在考えられる対処方法なのかもしれない。

【MUSIC EcoSystems BIZ編集者より】

是非、本インタビューを収録したビデオもあわせてご覧ください。記事には掲載されなかった部分も、ほぼ全て収録したノーカット版となります。